13. oktoobril ilmusid sotsiaalmeediasse väited, et foto tapetud lapsest, mida jagas Iisraeli peaminister, on võlts. Väidetavalt leidsid postitajad originaali, millel on kujutatud kutsikat, mitte aga surnud last. Tegelikult on koerapilt ise võltsitud.

Iisraeli peaministri Benjamin Netanyahu ametlik X-i konto (endine Twitter) postitas 12. oktoobril kolm fotot tapetud lastest. “Siin on mõned fotod, mida peaminister Benjamin Netanyahu näitas USA välisministrile Antony Blinkenile. Hoiatus: need on kohutavad fotod Hamasi koletiste poolt mõrvatud ja põletatud beebidest,“ seisab postituse kirjelduses.

Järgmisel päeval levisid sotsiaalmeedias postitused, milles väideti, et vähemalt üks neist fotodest on võlts. “Siin on originaalfoto, nad kasutasid aluseks päästetud kutsika fotot ja genereerisid AI-ga [tehisaru – toim] ülejäänu,“ seisab viraalseks läinud postituses.

Väide, et Netanyahu postitatud foto surnud lapsest olevat võltsitud, jõudis ka kohalikku portaali.

“Ben Shapiro, Ameerika ajakirjanik ja The Daily Wire’i peatoimetaja, postitas oma X-lehel foto väidetavalt põletatud imiku surnukehast neljakümne hulgas, mida ajakirjanikud (kes hiljem oma sõnu tagasi võtsid) ütlesid. Ütles ka Biden. Ja peale Bideni ja Shapiro ei näinud õnneks keegi teisi imikuid,“ kirjutas portaal Eesti Eest! 16. oktoobri artiklis.

“Lugejad kontrollisid aga kohe fotot ja selgus, et pilt on genereeritud graafilise närvivõrgu abil. Algselt oli sellel kujutatud armas koer. Tõde on sõja esimene ohver,“ kirjutas portaal.

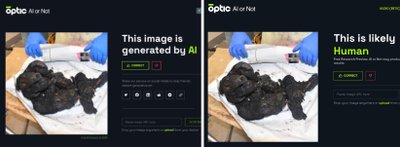

Venemeelne USA blogija Jackson Hinkle postitas oma X-i kontole kuvatõmmise AI or Not veebilehe fotoanalüüsi tulemusest, mille järgi olevat foto genereeritud tehisaru abil. AI or Not on teenus, mis määrab arendajate sõnul suure täpsusega, kas pildi on loonud tehisaru või inimene.

Ent ka sellised teenused võivad eksida. “AI or Not võib anda ebatäpseid tulemusi,“ seisab selle veebilehel. Faktikontroll kontrollis sama fotot surnud lapsest AI or Not veebilehel ja sai vastupidise tulemuse – “see on ilmselt inimese loodud“.

AI or Not teenus pole kaugeltki täiuslik. Veel sel suvel võrdles New York Times AI-piltide tuvastamise teenuseid ja leidis, et mõned sellised tööriistad ei anna alati õigeid tulemusi. Seega on loogiline, et ka üht fotot kontrollides ühes ja samas tööriistas võivad kasutajad saada erinevaid tulemusi.

Väidetav originaalfoto “armsast koerast“ läks populaarseks anonüümsest veebifoorumist 4chan. Populaarse postituse kirjelduses seisab: “Siin on originaalfoto, nad kasutasid aluseks päästetud kutsika fotot ja genereerisid AI-ga ülejäänu“.

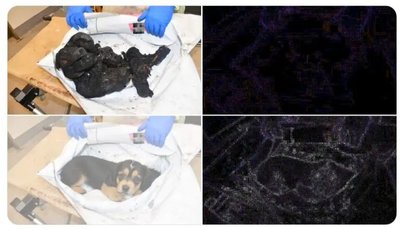

Arlington Posti X-i konto tegi veataseme analüüsi (Error Level Analysis ehk ELA – piltide autentsuse hindamise meetod) Iisraeli peaministri avaldatud fotole ja fotole koerast. Väljaanne järeldas, et surnud lapse fotot ei ole muudetud. Seda tõendab ühtlane muster, servade järjepidevus, ühtlased müramustrid ja stabiilsed eredustasemed. Ent koerapildil on selged digitaalse töötlemise jäljed, eriti kahtlastes kohtades piki koerakujutist – servad on ebaloomulikult teravad ja heledad, pildi eredustase on ebaühtlane.

RusDelfi uuris välja, et koerapilt pärineb kasutaja @stellarman22 X-i postitusest. Kasutaja avaldas koerafoto pärast Netanyahu postituse ilmumist ja kirjutas: “Mul kulus selle tegemiseks 5 sekundit. Enam pole raske teha veenvat võltsfotot. Videoid on raskem võltsida, kuid nad ei näita kunagi tõenditest videot“. See postitus on praeguseks kustutatud, kuid siin on koopia.

Seega on foto surnud lapsest tegelikult autentne ja pilt koerast on loodud tehisaruga.

Otsus: vale. Iisraeli peaministri Benjamin Netanyahu ametlik X-i konto postitas 12. oktoobril kolm fotot tapetud lastest. Järgnenud vastuväide, et üks foto on tehisaruga genereeritud võltsing, ei vasta tõele. Foto surnud lapsest on autentne. Pilt “armsast koerast“ on hoopis omakorda süvavõltsing, mis on genereeritud tehisaru abil. Seda kinnitas ka võltsingu autor.